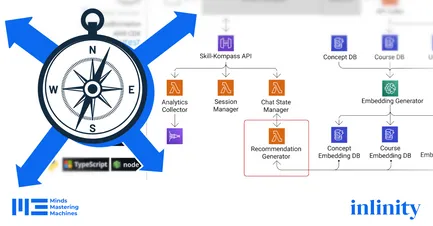

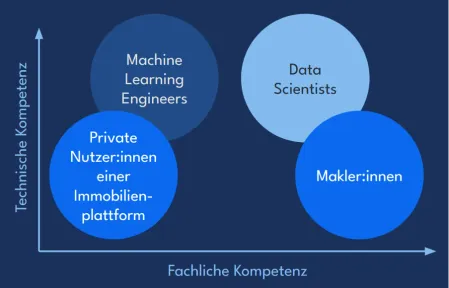

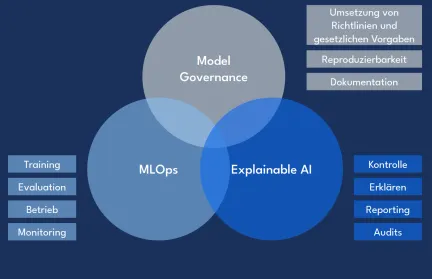

Das Textverständnis vortrainierter Large Language Models (LLMs) eröffnet neue Möglichkeiten für die Entwicklung von Empfehlungssystemen. Jedoch stellen Anforderungen des Datenschutzes, begrenzte Datenbasis und nicht zuletzt der Black-Box-Charakter der LLMs Hürden für ihren Einsatz dar.

Wir demonstrieren, wie Erklärbare KI und Feedback-Mechanismen eine selbstbestimmte Nutzung des Empfehlungssystems unterstützen. Darüber hinaus zeigen wir Strategien für datenschutzkonformen und kostengünstigen Betrieb LLM-basierter Lösungen auf.